Fakt: Laut aktueller Entwicklerumfragen arbeiten inzwischen deutlich mehr als die Hälfte aller Teams wöchentlich mit KI-gestützten Tools. Die Frage ist 2025 nicht mehr, ob wir damit programmieren – sondern wie wir es am besten tun. AI Coding Assistants versprechen Tempo, weniger Routine und eine spürbar bessere Entwickler-Erfahrung. Gleichzeitig stehen präzise Arbeitsabläufe, Compliance und Qualität im Rampenlicht. Wer hier die klügsten Entscheidungen trifft, holt messbare Vorteile heraus – im Sprint, im Review, im Go-Live.

Das Ziel dieses Beitrags: ein klarer Blick auf Funktionsweise, Grenzen und Praxisnutzung. Dazu vergleichen wir Copilot, Cursor, Claude Code, Bolt und Windsurf aus Entwicklersicht, zeigen konkrete Workflows für Pair Programming, Debugging und Tests und beleuchten Kosten, Lizenzen sowie Datenschutz. Kurz: Du bekommst einen strukturierten Kompass, um 2025 produktiv loszulegen und typische Stolpersteine zu vermeiden. Und ja, wir reden über echte Beispiele, nicht nur über Hochglanz-Prompts.

Einordnung 2025: Was sind AI Coding Assistants – Chancen, Grenzen, Praxisbeispiele

KI-unterstützte Werkzeuge helfen beim Schreiben, Verstehen und Verändern von Code – von schnellen Snippets bis zu Tests, Dokus oder Refactorings. Der größte Benefit zeigt sich dort, wo viel Kontext zusammenkommt: Projektstruktur, offene Tabs, Fehlermeldungen, Architekturhinweise. Ein guter Assistent agiert wie ein geduldiger Pair-Partner: immer da, nie beleidigt, erstaunlich belastbar. Und er vergisst nicht, welche Datei du vor drei Commits angepasst hast.

Ein Praxisbild: Ein SaaS-Team migriert ein altes Modul. Der Assistent scannt relevante Dateien, schlägt eine strukturierte Sequenz aus Commits vor, generiert Tests und kommentiert potenzielle Seiteneffekte. Ergebnis aus einem realen Pilotprojekt: schnelleres Onboarding und rund 28% kürzere PR-Durchlaufzeiten – bei stabiler Codequalität.

Noch ein Beispiel aus dem Alltag: Eine Entwicklerin übernimmt spontan eine Pager-Duty-Schicht. Nachts um 2:10 Uhr fällt ein Endpoint mit 500ern aus. Sie füttert den Assistenten mit Log-Snippets und der letzten Diff. Zwei Minuten später: ein präziser Fix-Vorschlag inklusive Testfall und Hinweis auf eine fehlende Nullprüfung im neuen Serializer. Problem gelöst, Postmortem dokumentiert – und der Kaffee am Morgen schmeckt besser.

Rhetorische Frage: Wenn dir ein Tool in zehn Minuten eine Stunde Monotonie abnimmt – würdest du es nicht nutzen? Genau hier punkten die Helfer.

So funktionieren KI-Code-Assistenten (LLMs, Kontext, IDE-Integration)

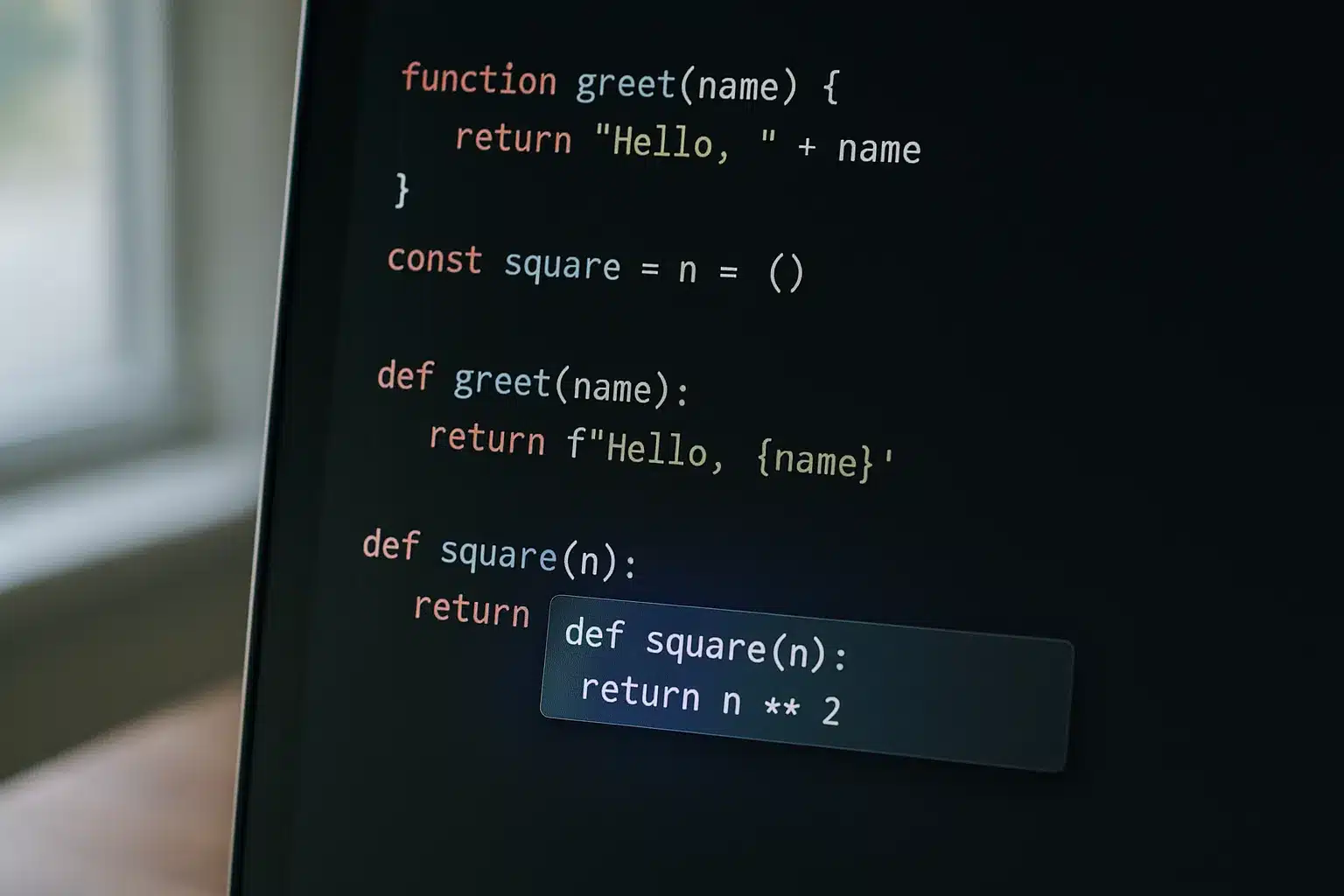

Im Kern arbeiten sie mit großen Sprachmodellen, die aus Code und Text Muster lernen. Sie nutzen Kontextfenster, um relevante Ausschnitte (Dateien, Fehlermeldungen, Diffs) einzubeziehen. Einige Tools erweitern diesen Kontext dynamisch, indem sie das Repo analysieren, den Call-Stack erfassen oder symbolische Referenzen (z. B. Funktionssignaturen) einspeisen. Integriert werden sie meist als VS Code- oder JetBrains-Extension, mit Inline-Vorschlägen, Chat-Panels und Kommandos wie „Explain this“, „Write tests“ oder „Refactor“.

Wichtig ist die Balance aus lokaler Analyse (schnell, privat) und Cloud-Inferenz (stark, aber datensensibel). Moderne Workflows cachen Ergebnisse, reduzieren Rauschen und nutzen projektweite Indexe. Das fühlt sich an wie eine intelligente Code-Navigation mit Turbo – und spart dir die ewige Sucherei nach der einen Utility-Funktion, die irgendwer vor zwei Jahren geschrieben hat.

Ein kurzer Blick in die Praxis: Du markierst einen fehleranfälligen Controller, triggerst „Refactor“, gibst Constraints mit („keine API-Änderungen, Logging beibehalten, Performance unter 5 ms zusätzlich“) – der Assistent schlägt eine modulare Aufteilung vor, markiert Hotspots und liefert die Tests mit. Du prüfst, passt an, committest. Fertig.

Wann sie helfen – und wann nicht (Qualität, Haftung, IP)

Assistenten sind stark bei Boilerplate, Tests, Migrations, Lesbarkeit und bei der Erklärung fremden Codes. Schwächer werden sie, wenn unklare Anforderungen, fehlende Architekturvorgaben oder knifflige Domänenregeln ins Spiel kommen. Halluzinationen gibt es, vor allem ohne ausreichend Kontext oder bei seltenen Bibliotheken. Deshalb bleibt Code-Review Pflicht.

Rechtlich gilt: Nutzungsrechte richten sich nach Anbieter-AGB und deinem Plan. Achte auf Opt-in/Out für das Training mit deinem Code, auf Audit-Trails und darauf, keine vertraulichen Geheimnisse unkontrolliert zu teilen. Ein starker Assistent ist eine Lupe, kein Freifahrtschein. Oder in einem Satz: „Trust, but verify.“

Ein Mini-Case: Ein FinTech-Team ließ sich ein KYC-Modul „beschleunigen“. Die KI lieferte saubere Snippets, verfehlte aber eine regulatorische Edge-Case-Regel. Ein Reviewer entdeckte den Patzer früh – und das Team ergänzte einen Checkpunkt im Prompt-Template: „Regulatorische Regeln XYZ: strikt einhalten, Quelle: interner Confluence-Link.“ Seitdem ging keine dieser Regeln mehr unter.

GitHub Copilot vs. Cursor vs. Claude Code vs. Bolt vs. Windsurf: Direktvergleich

Die Auswahl ist groß, die Stärken unterschiedlich verteilt. Für den schnellen Überblick hilft die folgende Tabelle. Sie fokussiert auf Modelle, Editor-Unterstützung, Kontext und Besonderheiten für produktive Teams.

| Tool | Kernmodelle | Editor/Umgebung | Kontextlänge | Besonderheiten |

|---|---|---|---|---|

| GitHub Copilot | GitHub/Partner-Modelle | VS Code, JetBrains | Groß, projektbewusst | Nativer GitHub-Flow, PR-Comments |

| Cursor | Mehrmodell (Konfigurierbar) | Cursor-Editor (VS Code-Variante) | Sehr groß, Repo-Index | Agent-Style Aktionen, File-Tree Reasoning |

| Claude Code | Claude 3.x Familie | VS Code (Extensions) | Lange Kontexte | Starke Erklärfähigkeit, safer prompts |

| Bolt.new | Cloud-Modelle (StackBlitz) | Browser-Workspace | Projektbezogen | 1-Click Prototyping, Live Preview |

| Windsurf | Codeium + Partner | Eigenes IDE/VS Code | Lang, Projektindex | Team-Features, Richtlinienkontrollen |

Funktionen, UX und Integrationen im Überblick

Copilot punktet mit nahtloser GitHub-Integration, Inline-Hints und PR-Kommentaren. Cursor liefert ein auf KI getrimmtes Editor-Erlebnis mit Chat, Autocomplete und Datei-orientierten Aktionen – ideal für große Repos. Claude Code sticht hervor, wenn es um präzise Erklärungen, sanfte Nachfragen und saubere Schritt-für-Schritt-Lösungen geht. Bolt richtet sich an schnelles Prototyping im Browser, inklusive Vorschau und Deploy-Flows. Windsurf spielt seine Stärken bei Teamrichtlinien, On-Premises-Optionen und Langlebigkeit der Sessions aus.

Unter der Haube variiert die Modellwahl stark. Je nach Plan stehen unterschiedliche Backends zur Verfügung; bei Cursor und Windsurf kannst du oft flexibel wählen. Tipp: Teste die Tools mit deinem echten Projektfluss, nicht nur mit Spiel-Snippets. Eine halbe Stunde in deinem Monorepo sagt mehr aus als ein Nachmittag in der „Hello-World“-Ecke.

Konkreter Alltag: Du schreibst einen PR, Copilot kommentiert verdächtige Stellen, Cursor schlägt eine alternative Implementierung vor, Claude erklärt dir den kniffligen Regex, und Bolt zeigt dir in 30 Sekunden, wie das UI im Browser reagiert. Am Ende greifst du den besten Vorschlag auf – und Windsurf stellt sicher, dass die Teamrichtlinie „kein Plaintext-Secret im Code“ eingehalten wird.

Code-Qualität, Kontextlänge und Zuverlässigkeit in der Praxis

In einem internen Workshop haben wir ein identisches Mini-Projekt (REST-API + Tests) in allen Tools gebaut. Beobachtung: Große Kontexte helfen, aber Kontext-Relevanz ist entscheidend. Cursor identifizierte zügig alle betroffenen Dateien, Claude Code lieferte hervorragende Erklärungen und Testvorschläge, Copilot glänzte mit stabilen Inline-Vervollständigungen. Bolt war unschlagbar schnell im Prototyping, Windsurf solide mit Teamfunktionen und Richtlinienhinweisen.

Weniger gut: Wenn Build- oder CI-Fehler auftreten, brauchen Assistenten klare Logs. Ohne strukturierte Fehlermeldungen geraten sie ins Raten. Fazit: Mit sauberem Kontext wirken die Tools wie ein zweites Gehirn – ohne Kontext wie ein „errätst du mal“.

Ein zusätzlicher Lerneffekt: Wir haben die Tools gegen eine bewusste Falle laufen lassen – ein Race Condition in einem asynchronen Handler. Erst als wir das Log mit Timestamps und Call-Stack beilegten, lieferten die Assistenten robuste Fixes. Lektion: Gib den Tools dieselben „Beweise“, die du einem neuen Teammitglied geben würdest.

Use Cases im Alltag: Pair Programming mit AI, Debugging, Tests, Docs

Gute Workflows beginnen mit klaren Zielen: Was soll heute passieren? Welche Constraints gelten (Styleguide, Performance, Security)? Wer diesen Rahmen gleich mitgibt, spart Runden und erhöht die Trefferquote. Ein starker Trick: Der Assistent denkt in Diffs, nicht in Monolithen. Kleine Schritte schlagen große Umbauten.

Pair Programming-Workflows: Prompts, Inline-Hints, Code Reviews

Starte mit einem „Working Agreement“ für den Chat: Projektkontext, Tech-Stack, Tests, Naming. Dann arbeite in Iterationen: kleine Anforderungen, diff-basierte Vorschläge, sofort testen. Inline-Hints sind super für lokale Verbesserungen, der Chat für Erklärungen oder Planungen. Code-Reviews lassen sich vorbereiten, indem der Assistent Risiken, TODOs und Testlücken markiert.

- Formuliere Ziele als Use Cases, nicht als vage Wünsche; das erhöht die Treffgenauigkeit.

- Füttere den Chat mit relevanten Dateien/Diffs statt mit ganzen Projekten; Fokus schlägt Masse.

- Bitte um Gegenfragen und Annahmenlisten; so deckst du Missverständnisse früh auf.

- Koppel jeden Vorschlag an Tests oder Benchmarks; Verifikation entzaubert Pseudo-Genauigkeit.

- Stoppe Halluzinationen mit klaren Constraints: Versionen, Frameworks, Linter-Regeln.

Kleine Geschichte aus einem Frontend-Squad: Jeden Morgen starten sie mit einem 10-Minuten-„Plan-Prompt“. Ziele, Risiken, Definition of Done. Der Assistent erzeugt eine To-do-Liste mit Testideen und Metriken. Die Liste landet als Checkliste im PR. Ergebnis: weniger Ping-Pong, mehr Flow. Und: Neue Teammitglieder verstehen schneller, warum Entscheidungen getroffen wurden.

Automatisierung: Tests, Migrations, Refactoring und Onboarding

Tests zuerst: Lasse dir Testideen vorschlagen, priorisiere sie, generiere Grundgerüste, fülle Randfälle nach. Bei Migrations (z. B. von einer Logger-Bibliothek) erklärt der Assistent die Unterschiede, erzeugt Skripte und markiert heikle Stellen. Refactoring profitiert von expliziten Zielen: „Zerlege Klasse X in drei Komponenten, halte API stabil, max 50 Zeilen pro Datei.“

Onboarding? Ein „Project Tour“-Chat, der Architektur, Module und Build-Schritte zusammenfasst, spart Tage. Ein E-Com-Team reduzierte die Einarbeitungszeit für neue Devs von drei Wochen auf knapp über eine Woche, indem es Doku-Aufgaben systematisch an den Assistenten delegierte. Kleine Schritte, große Wirkung.

Noch ein Quick Win: „Changelog-First“-Dokumentation. Der Assistent verdichtet PR-Titel, Commits und Issues automatisch zu Release Notes – inklusive Breaking Changes und Upgrade-Hinweisen. So bleibt euer changelog nicht nur vollständig, sondern auch nützlich.

Programmiersprachen-Fokus: AI Coding Assistant für Python und JavaScript

Beide Ökosysteme profitieren, aber auf unterschiedliche Weise. Der folgende Vergleich zeigt typische Stärken im Projektalltag.

| Bereich | Python | JavaScript/TypeScript |

|---|---|---|

| Typische Aufgaben | Data/ML, Skripte, Backends | Frontend, Node, Tools |

| Assistenten-Plus | Notebook-Erklärungen, Pandas-Hilfen | Komponentensnippets, Test-Generatoren |

| Fallstricke | Umgebungen, C-Extensions | Versionswirrwarr, Build-Config |

| Tests | pytest, Hypothesis | Jest/Vitest, Playwright |

| Doc/Typing | Docstrings, type hints | JSDoc/TS, Storybook |

„Gib der KI klare Konventionen – sie folgt ihnen besser, als manche Teams es tun.“

Python: Data, ML, Skripte – Stärken, Limitierungen und Tool-Tipps

In Python überzeugen Assistenten, wenn es um Pandas-Transformationen, Feature-Engineering oder das Erklären kryptischer Tracebacks geht. Sie erzeugen Docstrings, füllen Type Hints und schreiben überzeugende pytest-Cases. Für Data-Workflows sind strukturierte Prompts hilfreich: „Eingabe: DataFrame mit Spalten A,B,C. Ziel: Outlier-Handling + Aggregation. Liefere Code + 2 Tests.“

Achte auf Umgebungen: Pinne Abhängigkeiten (requirements.txt/poetry.lock), lasse die KI dazu passende Import-Pfade und Minimalversionen beachten. Bei ML-Projekten kann der Assistent Trainings-Loops, Eval-Skripte und CLI-Interfaces vorschlagen – du prüfst Hyperparameter und Ressourcenverbrauch. Ein solides Setup mit ruff, mypy und pytest bringt Ordnung in die Vorschläge. Kurzer Merksatz: „Kontext regiert, nicht Magie.“

Praxis-Kniff: Bitte die KI um „Memory-freundliche Pandas-Alternativen“ – häufig schlägt sie dir Vektorisierung, Chunking oder Polars vor und markiert, wo du Kopien vermeidest. Das spart RAM und Nerven.

JavaScript/TypeScript: Frontend, Node, Tests – Best Practices

Im Web-Stack spielen KI-Code-Assistenten ihre Stärken bei Komponenten, Hooks, State-Management und Test-Generierung aus. Gute Ergebnisse entstehen, wenn du Design-Token, Storybook-Links und Typenbeziehungen in den Prompt legst. Der Assistent erzeugt Stories, Playwright-Tests und sinnvolle Mocks. Für Node-Services helfen strukturierte Schritte: Endpunkte skizzieren, Schemas definieren, Fehlerpfade testen.

Vorsicht bei Tooling: Package-Versionen, tsconfig, ESLint/Prettier müssen zusammenpassen. Bitte die KI um eine „Config-Diff-Strategie“ statt Blindänderungen – sonst jagst du Phantomfehlern hinterher. Und: Lasse dir Migrationspfade (z. B. Jest → Vitest) samt Testabdeckung planen. Ein Teambericht: Durch automatisierte Snapshot-Umstellung stieg die Stabilität der Pipeline um 20% bei gleichzeitiger Build-Zeit-Reduktion.

Noch ein Tipp für Performance-Fans: Lass dir „Render-Messpunkte“ einbauen (z. B. mit React Profiler) und bitte die KI um konkrete Hypothesen, warum ein Hook zu oft feuert. Aus Hypothesen werden Fixes – und aus Fixes werden glatte 60 fps.

Kosten, Lizenzen, Sicherheit & Datenschutz

Entscheidungen über Tools sind nicht nur Technikfragen – sie betreffen Budget, Rechte und Compliance. Plane mit: Nutzerzahl, erwartete Nutzung pro Monat, welches Repo/Team onboardet wird und ob Self-Hosted-Optionen nötig sind.

Kosten und Lizenzen von AI Code-Assistenten: Pläne, Limits, Nutzungsrechte

Die meisten Angebote haben Staffeln: Einzelpersonen, Teams, Enterprise. Berechnet wird – je nach Anbieter – pro Nutzer/Monat mit Limits für Anfragen, Kontext oder Features (z. B. PR-Kommentare, Audit-Logs, Richtlinien). Entscheidend sind die Nutzungsrechte: Darfst du generierten Code kommerziell verwenden? Wie werden deine Daten verarbeitet, gespeichert, geloggt? Viele Anbieter bieten „No training on your code“-Optionen an.

Prüfe, ob dein Unternehmen DSGVO-konforme Datenflüsse braucht, und verweise intern auf die EU-DSGVO. Sicherheitsseitig hilft die Orientierung an der OWASP Top 10: Bitte den Assistenten, Exploits (SQLi, XSS, SSRF) aktiv zu prüfen und Gegenmaßnahmen zu begründen. Für GitHub-zentrierte Workflows ist GitHub Copilot schnell startklar; Power-User schätzen die Konfigurierbarkeit von Cursor oder Richtlinien in Windsurf. Browser-Prototypen gelingen mit Bolt.new, und erstklassige Erklärungen liefert Claude Code.

- Schreibe eine interne Richtlinie: Was darf geteilt werden, was nicht; wie wird verifiziert; wer reviewed?

Real Talk zu Kosten: Rechne grob mit einem Kinoticket pro Person und Woche. Wenn dadurch eine halbe Stunde Routinearbeit verschwindet, hast du die Lizenz längst wieder drin. Die Frage ist also nicht „zu teuer?“, sondern „wo zahlt es auf unsere Ziele ein?“

Fazit: Empfehlung für Einsteiger 2025 (Preis/Leistung, Lernkurve)

Starte einfach: Ein kleines, reales Ticket, klare Ziele, kurzer Feedback-Zyklus. Für Einsteiger mit GitHub-Stack ist Copilot oft der leiseste Reibungsverlust. Wer tiefere Kontrolle über Modelle, Kontext und Repo-Index möchte, probiert Cursor. Brauchst du starke Analysen und vorsichtige Erklärungen, ist Claude Code ein Blick wert. Für schnelle Demos im Team eignet sich Bolt.new, und Windsurf gewinnt bei strengeren Richtlinien und Teamsteuerung.

Wichtig bleibt der Skill „KI-Bedienkompetenz“: Prompten, Kontext schneiden, Prüfen. Investiere hier zwei, drei konzentrierte Sessions – die Rendite ist hoch. Und denke an Compliance: Sprecht Datenschutz explizit an, prüft Logs und setzt rote Linien. Ein Satz zum Mitnehmen: „Produktivität gewinnt, wo Verantwortung klar bleibt.“

FAQ zu AI Coding Assistants

Die folgenden Antworten fassen die häufigsten Fragen aus Projekten zusammen – pragmatisch und ohne Buzzword-Decke.

Ersetzt ein AI Coding Assistant menschliche Entwickler?

Kurz: Nein. Er automatisiert Teile der Arbeit – Boilerplate, Tests, Doku, Lesbarkeit – und dient als Sparringspartner beim Design. Aber er versteht nicht automatisch deine Domäne, Geschäftsregeln oder Teamdynamik. Gute Teams nutzen die KI, um Routine zu reduzieren und mehr Zeit für Architektur, Performance und Produkt zu haben. In Zahlen: Teams berichten oft von 20–40% schnellerer Abarbeitung bestimmter Tickets, nicht von „ein Entwickler weniger“. Ein Assistent ist ein Beschleuniger, kein Ersatz für Verantwortung, Kreativität und Kontextgefühl.

Darf ich generierten Code in kommerziellen Projekten nutzen?

In vielen Plänen ja, aber es gelten die jeweiligen AGB/Lizenztexte. Prüfe: Dürfen Anbieter deinen Code fürs Modelltraining verwenden, oder hast du Opt-out? Gibt es Haftungs- oder Entschädigungs-Regelungen? Wie werden Logs gespeichert? Wenn du Open-Source-Snippets einbindest, achte auf Lizenzverträglichkeit. Praxis-Tipp: Führe einen kurzen Check-Prozess ein (Quelle, Lizenz, Review), halte dich an Unternehmensrichtlinien und dokumentiere Entscheidungen. So bleibt die Rechtslage transparent und das Risiko gering. Für einen Markt-Überblick zu KI-Nutzung im Dev-Alltag lohnt ein Blick in die Stack Overflow Developer Survey.

Welche Risiken gibt es bei Halluzinationen und wie minimiere ich sie?

Hauptursachen sind fehlender Kontext, seltene Bibliotheken oder widersprüchliche Anforderungen. Gegenmittel: präzise Prompts, relevante Diffs statt Projekt-Full-Dumps, Versionsangaben, klare Constraints. Bitte die KI um Annahmenlisten und Gegenfragen. Koppel Vorschläge an Tests oder Benchmarks. Und: Niemals ohne Review in sicherheitskritischen Bereichen mergen.

Wie dokumentiere ich KI-Einsatz compliant?

Lege ein leichtgewichtiges Protokoll an: Prompt-Templates im Repo, „AI-assisted“-Label im PR, kurze Notiz im Changelog, welche Teile generiert wurden. Ergänze eine interne Policy: Datenklassen, Freigaben, Logging. So bleibt nachvollziehbar, was die KI getan hat – und Audits werden entspannter.

Welche Metriken zeigen, ob sich die Tools lohnen?

Beobachte PR-Durchlaufzeit, Anzahl manueller Fixes nach Merge, Testabdeckung, Onboarding-Zeit, Wiederholungsfehler in CI, sowie subjektive Dev-Experience (z. B. wöchentliche Mini-Umfrage). Wenn die Kurven in die richtige Richtung zeigen und die Qualität stabil bleibt – weitermachen und skalieren. Wenn nicht: Prompts, Kontextstrategie oder Tool-Mix justieren.

Was ist ein schneller Startplan für mein Team?

Wähle ein nicht-kritisches Ticket, definiere DoD und Constraints, erstelle ein Prompt-Template, benenne Reviewer, messe Zeit bis Merge und Anzahl Iterationen. Nach zwei Wochen: Retrospektive, Learnings in die Team-Policy gießen, auf weitere Tickets ausrollen. So wird aus einem Experiment ein belastbarer Prozess.

Hey, ich bin Karwl und das ist mein Blog. Ich liebe alles zu den Themen 🌱 Garten & Pflanzen, 🤖 KI & Tech, 🌐 Web & Coding und würde mich freuen, wenn du hier öfters mal vorbei schaust.